Gli algoritmi informatici non sono come le leggi fatte dai legislatori dove si dice: "fatta la legge, trovato l'inganno". Con l'algoritmo, quello non si può dire, ma si può solo dire: "fatto l'algoritmo, trovato il baco". I bachi, cioè gli errori logici dei programmatori, sono le uniche insidie che affliggono gli algoritmi.

Gli algoritmi informatici non sono come le leggi fatte dai legislatori dove si dice: "fatta la legge, trovato l'inganno". Con l'algoritmo, quello non si può dire, ma si può solo dire: "fatto l'algoritmo, trovato il baco". I bachi, cioè gli errori logici dei programmatori, sono le uniche insidie che affliggono gli algoritmi.

La parola Algoritmo che, secondo il dizionario Zingarelli, matematicamente significa: procedimento per la risoluzione di un problema, è un insieme di istruzioni e comandi scritti dai programmatori per istruire un computer o un robot a prendere decisioni, risolvere problemi, svolgere dei lavori.

L'algoritmo è l'anima di un computer e non è influenzato dai sentimenti umani e nemmeno dalla fatica fisica o mentale. L'algoritmo non soffre e non gioisce, non si lascia corrompere, ma fa soltanto quello che il programmatore gli ha insegnato a fare, né più né meno.

Anna Masera, valente giornalista del quotidiano La Stampa, scrive sul giornale del 5 marzo 2019 un articolo dal titolo: "Gli algoritmi in redazione" dove dice che il quotidiano fa uso di robot, ventilando lo spauracchio di un lettore che i robot possano prendere il posto dei giornalisti. Lei spera di no, io invece spero di sì. Spero di sì non per vedere giornalisti disoccupati, ma per poter affrancare i giornalisti dal loro lavoro affinché possano dedicarsi a quello che più piace, sia anche un giornalismo più consapevole. Poi Anna Masera dice che gli algoritmi fanno notizia quando sbagliano e fanno errori, non sono neutrali.

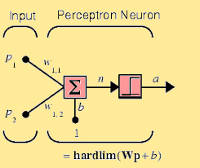

L'Intelligenza Artificiale, il Machine o Deep Learning, come le reti neuronali e via discorrendo, non sono una novità dell'Informatica, ma ne sono solo la frontiera, dove algoritmi ad apprendimento di rafforzamento con o senza supervisione accompagnati da una notevole mole di dati raccolti ed elaborati da altrettanti algoritmi di regressione lineare su base statistica, o da algoritmi di classificazione, sono all'ordine del giorno dell'Informatica nel campo dell'AI. Già nel lontano 1957 lo psicologo americano Frank Rosemblatt, mise a punto un algoritmo conosciuto come il Perceptron, un modello che simulava il funzionamento di apprendimento automatico di un neurone del cervello umano, implementato poi su computer IBM. Ci sono algoritmi progettati per apprendere dai propri errori e non sono perfetti. Che gli algoritmi non siano neutrali, in questo caso, dipende dai dati raccolti. Se i dati raccolti sono già polarizzati in una direzione perché sono stati raccolti in un ambiente non neutrale o sono dati che inglobano discriminazioni razziali, anche l'algoritmo che li elabora tenderà a dare in uscita risultati non neutrali, polarizzati e discriminanti secondo la tendenza sociale dalla quale provengono e da dove sono stati raccolti i dati.

Gli algoritmi, tuttavia, opportunamente implementati su computer e robot, possono affrancare l'uomo da moltissimi lavori ripetitivi e noiosi, permettendo al lavoratore di dedicarsi ad altro, di dedicarsi a ciò che piace. Purtroppo per una corretta progettazione e funzionamento di un algoritmo di AI occorrono grandi quantità di dati il più possibile eterogenei, dati che la nuova assurda e a mio giudizio idiota normativa europea sulla protezione dei dati (GDPR) rende difficile e rischioso raccogliere e conservare per i programmatori e i soggetti responsabili. Poi bisogna dire che in una società competitiva come quella occidentale, dominata dalla Proprietà Privata, cioè dall'esproprio coatto, dominata dal libero mercato, gli algoritmi di AI vengono sfruttati per incrementare il profitto e la speculazione dei soggetti privati, senza alcun riguardo delle conseguenze morali, sociali ed etiche, con il rischio di peggiorare gli squilibri sociali.

Per questo penso che occorra eliminare la Proprietà Privata, per prima cosa, se non si vuole finire nel baratro di una società senza scrupoli.

Comments